先端チップやAIチップの開発をめぐる熾烈な争いが加速

TSMC[TSM]、インテル[INTC]、アドバンスト・マイクロ・デバイシズ[AMD]らが開発競争

台湾や米国の複数メディアが報じたところによると、半導体製造大手のTSMC(台湾セミコンダクター・マニュファクチャリング)[TSM]が、世界最先端となる回路線幅1.4ナノ(ナノは10億分の1)メートルの半導体開発を進めていることが明らかになった。現在の最先端である3ナノ品の2世代先の技術となり、TSMCが1.4ナノ品の開発に具体的に言及するのは初めてのことである。

日本経済新聞の2023年12月15日付けの記事「TSMC、最先端『1.4ナノ』半導体開発へ 現行の2世代先」によると、1.4ナノ品は2027-2028年の量産開始が見込まれるとしている。TSMCの3ナノ品は2022年末に量産が始まり、現在ではアップル[AAPL]のiPhoneなどに採用されている。次世代の2ナノ品は3ナノ品に比べて処理速度が10-15%速く、2025年の量産開始を予定している。1.4ナノ品はさらなる性能向上が見込まれる。

一方、PCプロセッサ製造で最大手のインテル[INTC]は14日、AI(人工知能)ハードウエア市場でのシェア拡大を目指し、パソコンやデータセンター向けの新たな半導体を発表した。ここ1年足らずで2度目の見直しを行い、性能とメモリを向上させながら消費電力を減らしたという。

また、米AMD(アドバンスト・マイクロ・デバイシズ)[AMD]は6日、米カリフォルニア州サンノゼ市で技術イベントを開き、サーバーやパソコン向けのAI(人工知能)半導体の新製品を発表した。イベントに登場したリサ・スーCEO(最高経営責任者)は、「AIは過去50年で最も革新的な技術で、普及速度はインターネットの登場に比べてずっと速い」と述べた。

AIツールは半導体業界にとって期待の活路

AI技術の向上と同時にAIの性能を最大限に発揮できるAI半導体チップの開発競争が加速している。AI半導体チップとは、AIの演算処理を高速化するために設計された専用の半導体チップである。

AIが使われる範囲が拡大すると同時に、機械学習(マシンラーニング)や深層学習(ディープラーニング)が台頭している。AIの学習に必要な計算量は飛躍的に増加しており、汎用プロセッサだけでは処理が追いつかなくなっている。膨大な量のデータを高速に処理することができる、高性能で消費電力を抑えた専用チップを求める需要が高まっているのだ。

ウォール・ストリート・ジャーナルの2月24日付けの記事「生成AIに沸く半導体業界、未来のドル箱狙う」によると、半導体メーカーが最新のハイテク技術を巡る熱狂に沸いているという。最小限の指示で文章を生成する注目の人工知能(AI)ツールは大量の演算能力を必要としており、半導体業界にとっては新たな成長の活路として期待が高まる。

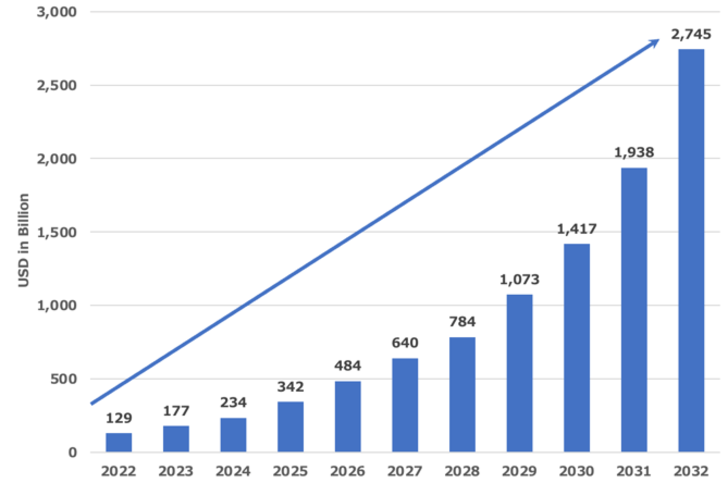

米調査会社のMarket.USのレポートによると、世界のAI市場は2032年に2兆7450億ドルまで拡大すると試算されている。年平均成長率は約36%だ。

半導体の性能進化が支えるAIブーム、過去2回とは異なる理由

AMDのAI半導体新製品、マイクロソフト[MSFT]他の複数大手AI企業が採用

今回AMDが発表したAI半導体の新製品は、GPUである「Instinct MI300X」と、CPUとGPUを組み合わせたAPU(Accelerated Processing Unit)である「Instinct MI300A」だ。

「MI300X」はチップ上におけるGPUなどの配置を最適化してデータを効率よくやりとりできるようにしたもので、スーCEOは、エヌビディア[NVDA]の主力AI半導体「H100」の性能に匹敵すると強調した。前世代製品よりもコンピューティングユニットは約40%多く、メモリ容量は1.5倍、ピーク理論メモリ帯域幅は1.7倍とのこと。生成AIの技術基盤を開発するために大量のデータを読み込ませる際の性能はH100と同等で、生成AIが回答を出力する推論ではMI300Xが上回るという。

すでに複数の大手AI企業が「MI300X」の採用を表明しており、マイクロソフト[MSFT]は自社のクラウドサービス「Azure」向けに採用することを明らかにした他、メタ・プラットフォームズ[META]、オープンAIも採用する。また、オラクル[ORCL]も自社のクラウド事業にMI300Xを使うことを表明している。

もうひとつの「MI300A」はGPUとCPUコアを組み合わせたもので、ハイパフォーマンスコンピューティングとAI向けのデータセンターAPUとしては世界初と位置づけられている。特にエネルギー効率に優れており、前世代製品と比較するとワット当たりのHPCワークロードパフォーマンスは約2.6倍とのこと。また、AI性能ではH100とほぼ互角であるが、HPCの分野では最大1.8倍のパフォーマンスを示しているとのことである。

「ムーアの法則」で進化してきた半導体の性能進化がAI技術を実現

半導体集積回路(半導体チップ)が発明されたのは1958年頃。それから60年余り、半導体チップは約2年で性能が2倍になるという「ムーアの法則」と共に進化を遂げてきた。当時開発されたチップには約60個のトランジスタしか搭載されていなかったが、微細化、小型化が進み、現在のチップはマイクロチップ上に数十億個のトランジスタをエッチングすることができるようになった。いま、私たちがスマートフォンという小型コンピュータをポケットに入れて持ち運べるようになったのは、「ムーアの法則」に基づく半導体の性能進化が背景にある。

世界は現在、3度目となるAIブームに湧いている。AI技術は、1950年代に1つの分野として確立されて以来、流行と衰退の波を繰り返し、これまで景気後退によってAI研究の資金源が閉ざされた「AIの冬の時代」と呼ばれた時代を1970年代と、1980年代後半から1990年代前半にかけて経験した。しかし、今回は過去2回のブームの時とは異なる状況にある。当時はコンピュータがソフトウェアを動かすのに十分な性能を持っていなかったが、今では大量のデータと非常に強力なコンピュータによって、A I技術を実現することができるようになったのである。

2023年12月7日の日本経済新聞の記事「米AMD、新型AI半導体を発表『市場成長、年70%に』」によると、生成AIの開発にはデータの並列処理を得意とするGPUが不可欠で、AI企業の間でエヌビディアのH100の争奪戦が起きていた。AMDは代替の選択肢を提供してエヌビディアの独走を食い止め、成長市場の一部を取り込みたい考えだと指摘している。

スーCEOは、AI半導体市場の拡大が予想を大きく上回っているとし、今後4年のデータセンター向けの成長率の見込みを従来の年率50%から同70%に引き上げた。市場規模については、従来予想の1500億ドルから2027年に4000億ドルを超えるとの見方を示した。

CPU、GPU、APUの違いはどこにあるのか?

AI技術の進化をサポートしているのがCPUやGPUと呼ばれる幾つかのチップである。それぞれどのような特徴を持っており、どのような違いがあるのか。クラウドストレージサービスを展開する米Backblazeがまとめたブログ記事を参照に、それぞれの特徴を確認しておこう。

CPU:セントラル・プロセッシング・ユニットとは?

CPUは「Central Processing Unit(中央演算処理装置)」の略称で、名前の通り、コンピュータの中心的な役割を果たしており、ハードディスクやメモリなどの周辺機器に接続されてデータを受け取り、それらの制御やデータの演算を行っているデバイスである。

大きく分けて、算術論理演算装置(ALU)と制御装置の2つの部分がある。ALUは算術演算(足し算、引き算など)や論理演算(AND、OR、NOTなど)を行う一方、制御を担当するコントロール・ユニットは、ALU、メモリ、入出力(IO)機能を制御し、メモリから読み出されたプログラムにどう対応するかを指示する。

CPUは、PCでの文書作成やロケットの進路計算、銀行の取引処理など多様な用途に用いられている。CPUでも機械学習を行うことは可能だが、CPUは「計算の度にメモリにアクセスする」という特徴を持っていることから、機械学習のように大量の計算を実行する際にはメモリ通信速度がボトルネックとなって処理速度が遅くなる。

そこで、特定のタスクに最適化されたチップに対する需要が生まれてきた。専用チップは、機械学習アルゴリズムがCPUに与える処理の難しさを解決するために設計されている。

GPU:グラフィックス・プロセッシング・ユニットとは?

GPUは「Graphics Processing Unit」の略称で、算術論理演算ユニットと呼ばれるように、ALUが数千個搭載されたものである。「大量の計算を並列処理する」という操作を得意としていることから、CPUと比べて圧倒的に高速な機械学習が可能となる。

一般的に画像処理関係の演算は計算量が多く、3DのCG画像をリアルタイムで表示する場合などには、高い処理能力が必要になる。この画像処理に特化したデバイスがGPUである。そのため、GPUをPCなどで使用する場合、コンピュータ全体を制御するCPUと組み合わせて使用する必要がある。

GPUやメモリ、入出力機器などをセットにしたグラフィックスボードがよく知られているように、GPUはゲームやCG処理などにも活用できる汎用チップという側面を持っているため、機械学習専用に設計されたチップと比べると効率が劣る。また、大量のエネルギーを使用することが課題として指摘されている。

長い間ゲームに使われてきたGPUが一般的なコンピューティングに使われるようになったのは2000年代に入ってからとのこと。ゲーム用PCやゲーム機などリアルタイムで画像処理をする必要がある場合は、CPUとは別にGPUをコンピュータに搭載することで、処理の高速化を図っている。

APU:アクセラレーティッド・プロセッシング・ユニットとは?

APUはAccelerated Processing Unitの略であり、AMDが独自に販売しているデバイス製品の名称である。特徴としては、CPUとGPUを1つのデバイスに収めているということ。一般的にGPUを使用する場合、CPUと組み合わせて2チップ以上でシステムを構成することが多いが、APUを使えば1チップのみでシステムを構成することができ、製品の小型化などが期待できる。

このように集積回路を構成するCPUやGPU、アクセラレータ等、機能ごとの複数のチップをそれぞれ最適なプロセスを使って製造し、それらを組み合わせて一つのチップとしてパッケージ化する技術をチップレット技術という。集積回路を同一プロセスで一つのチップ上で製造する従来の製法と比べて、コスト低減と高性能動作の両立が可能とみられている。

チップレット技術が半導体業界の勢力図を一変させるか

近年、半導体の微細加工技術が高度化するにつれて、製造時の歩留まりを高めることが困難になってきた。微細加工技術の進歩だけではムーアの法則を維持するのが難しくなってきたのだ。チップレットを適用することで、微細化の効果を継続できるだけでなく、チップに新たな価値をもたらすメリットも得られるようになる。

半導体製造装置大手、東京エレクトロンが運営するサイト「TELESCOPE magazine」に掲載されている記事「半導体業界構造を一変させる技術!?『チップレット』とは?」は、ムーアの法則が頭打ちになる窮地を救う可能性を持っているのがチップレット技術であり、このチップレット技術によって半導体の業界構造や勢力図が一変する可能性もあると指摘している。

石原順の注目5銘柄